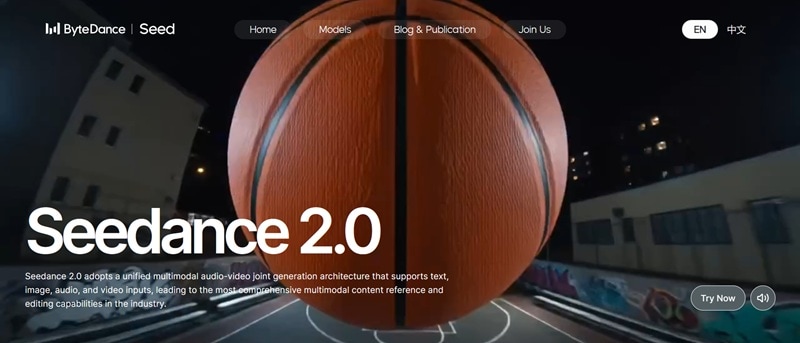

Se hai seguito l'industria dei video AI, avrai probabilmente notato quanto velocemente le cose si stiano muovendo. Ogni strumento mira a creare video migliori e più realistici in pochi secondi, e ByteDance non si trattiene—il suo ultimo Seedance 2.0 è una spinta importante in quella corsa.

Questo generatore di video AI ha rapidamente rubato la scena, confrontandosi con altri modelli leader come Kling 3.0 e Sora 2 in termini di qualità del movimento e coerenza della scena. Ma dovresti provarlo?

Daremo uno sguardo più approfondito a Seedance 2.0, incluso cosa c'è di nuovo, la qualità dell'output, i prezzi e dove ancora presenta lacune.

Panoramica della Tabella di Seedance AI

| Caratteristica | Dettagli |

| Nome del Modello | Seedance |

| Versione Corrente | 2.0 (rilascio iniziale febbraio 2026; distribuzione globale da marzo 2026) |

| Sviluppatore | ByteDance |

| Metodi di Input | Testo, immagine, video, audio |

| Audio | Generazione Nativa a Doppio Ramo (Suono Sincronizzato) |

| Qualità del Movimento | ★★★★✰ |

| Aderenza al Prompt | ★★★★★ |

| Coerenza Temporale | ★★★★✰ |

| Fedeltà Visiva | ★★★★✰ |

| Accesso API | Non ancora disponibile (per Seedance 2.0) |

Parte 1. Versione Corrente e Funzionalità di Seedance AI

Internet è stata completamente travolta ultimamente da video virali realizzati con Seedance 2.0, l'ultima versione di Seedance AI. Molti dei video sono incredibilmente realistici, alcuni presentano addirittura grandi star di Hollywood e personaggi iconici del cinema in scene di combattimento ad alta tensione.

Oltre ai video virali, Seedance 2.0 rappresenta un enorme balzo in avanti rispetto alla prima versione. Lanciato da ByteDance all'inizio del 2026, è una "Potenza Multimodale" che supporta testo, foto, video e persino file audio come input con controllo su performance, illuminazione e movimento della telecamera.

Video: QingQ77 (su X)

Se lo confronti con la versione precedente (Seedance 1.5 e 1.0), ci sono alcuni aggiornamenti che differenziano Seedance 2.0.

| Seedance 1.0 | Seedance 1.5 | Seedance 2.0 | |

| Durata video | Fino a 10 secondi | Fino a 12 secondi | Fino a 15 secondi |

| Risoluzione video | Fino a 1080p | Fino a 1080p | Fino a 1080p |

| Modalità di Input | Testo, immagine | Testo, immagine, video | Testo, immagine, video, audio |

| Integrazione audio | |||

| Sistema di Riferimento |

Funzionalità di Seedance 2.0

1. Generazione Nativa Audio-Video

La maggior parte dei generatori AI richiede ancora di cercare effetti sonori in seguito, ma Seedance 2.0 può gestire sia il visivo che l'audio in un colpo solo. Utilizzando un sistema a doppio ramo, genera video e audio esattamente allo stesso tempo. Ottieni una sincronizzazione labiale a livello di fonema per i personaggi e suoni foley che arrivano esattamente quando dovrebbero.

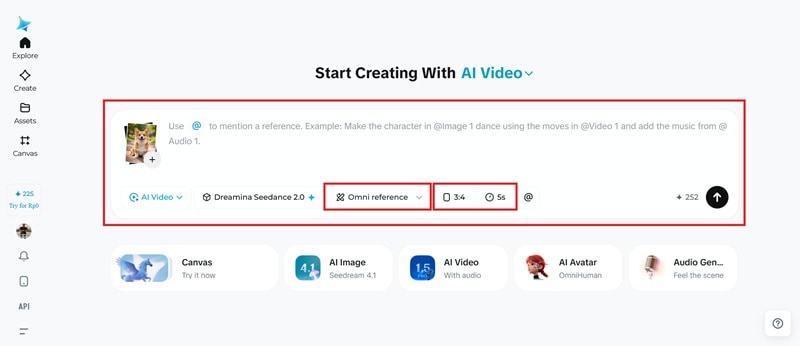

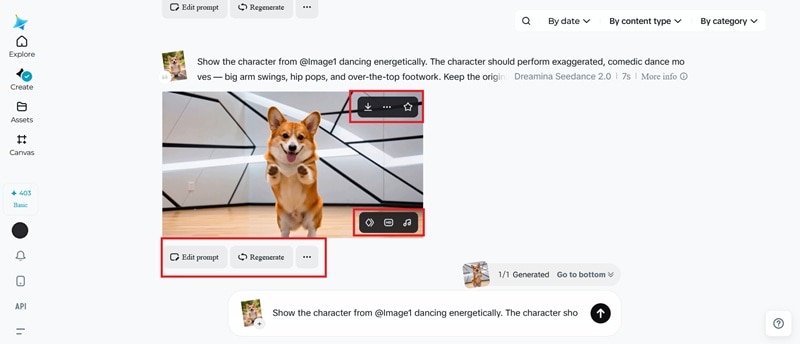

2. Supporto per Fino a 12 File di Riferimento

Con il suo nuovo flusso di lavoro multimodale, Seedance 2.0 utilizza un sistema "Omni Reference" che ti consente di caricare fino a 9 immagini, 3 video, e 3 clip audio (totale 12) per fungere da modelli. Utilizzando il sistema @mention (maggiori informazioni su questo in seguito), puoi bloccare volti, stili e movimenti specifici e fornire all'AI esattamente ciò di cui ha bisogno per mantenere una perfetta coerenza in ogni inquadratura.

3. Intelligenza della Telecamera a Livello di Regista

Invece di sperare che l'AI scelga una buona angolazione per te, puoi letteralmente decidere le inquadrature. Seedance 2.0 comprende cinematografia complessa come Dolly Zoom, riprese di tracciamento e messa a fuoco differenziale. Se hai una visione specifica, puoi persino caricare un video di riferimento di un movimento di telecamera e l'AI replicherà esattamente quel movimento per la tua nuova scena.

4. Qualità del Movimento Consapevole della Fisica

Il più grande indizio per i video AI era il movimento "fluttuante". Seedance 2.0 è progettato per risolvere questo problema con un migliore senso comune della fisica. Comprende come funziona la gravità, come il tessuto dovrebbe drappeggiare su una spalla e quanto pesante dovrebbe sembrare un'auto quando prende una curva stretta.

Parte 2. Come Usare il Generatore di Video Seedance AI

Se sei stato ansioso di testare Seedance 2.0, ByteDance lo ha lanciato ufficialmente a livello globale dal 23 marzo 2026, anche se è ancora in una fase di distribuzione graduale, come ha confermato il team CapCut su X. È attualmente disponibile in Indonesia, Filippine, Tailandia, Vietnam, Malesia, Brasile e Messico, con altre regioni a seguire.

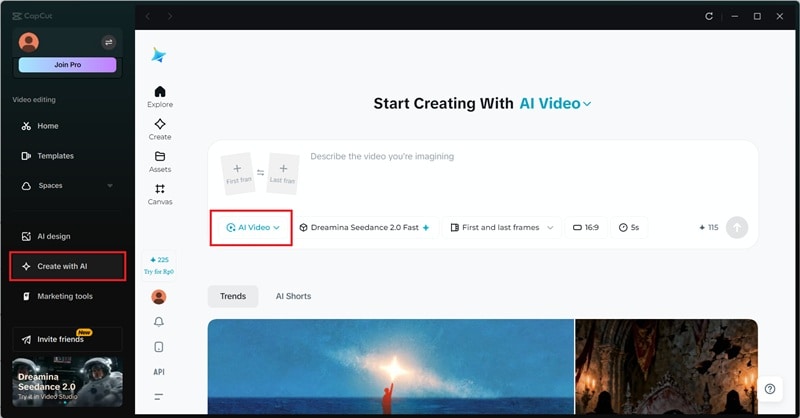

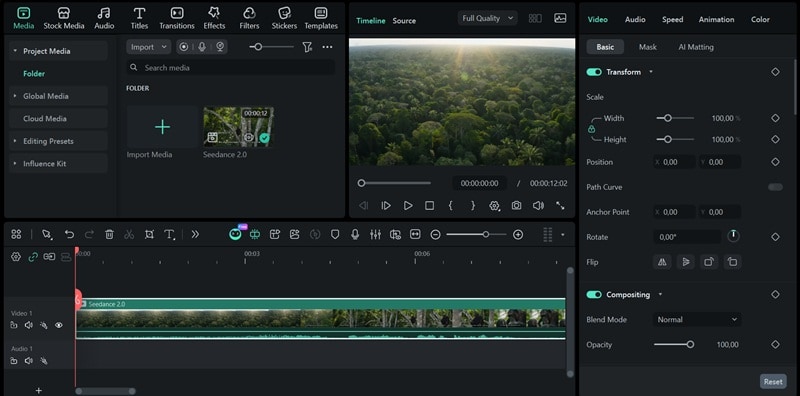

Se hai già accesso a Seedance 2.0, puoi usarlo su Dreamina, nelle app desktop e mobile di CapCut, o in Wondershare Filmora. In Filmora, la generazione e l'editing della timeline vivono in un'unica app—e il ToMoviee AI hub di template è costruito attorno a Seedance 2.0: scegli un preset, ottieni una struttura in stile storyboard e tagli sincronizzati con il ritmo, poi perfeziona il risultato senza uscire da Filmora.

Nota: Se vuoi ancora usare Seedance 1.5 o Seedance 1.0, queste versioni sono ancora disponibili tramite BytePlus (ModelArk).

Come Usare il Generatore Video Seedance 2.0

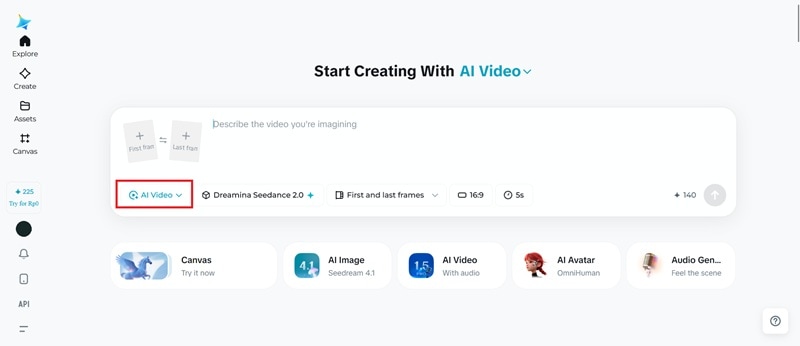

Inizia visitando il sito web di Dreamina. Se arrivi dal sito ufficiale di Seedance AI, clicca Prova Ora e verrai reindirizzato automaticamente. Seleziona Video AI.

Se preferisci lavorare all'interno di CapCut, apri l'app, tocca Crea con AI, e seleziona Video AI. Puoi anche usare Seedance 2.0 su Video Studio di CapCut.

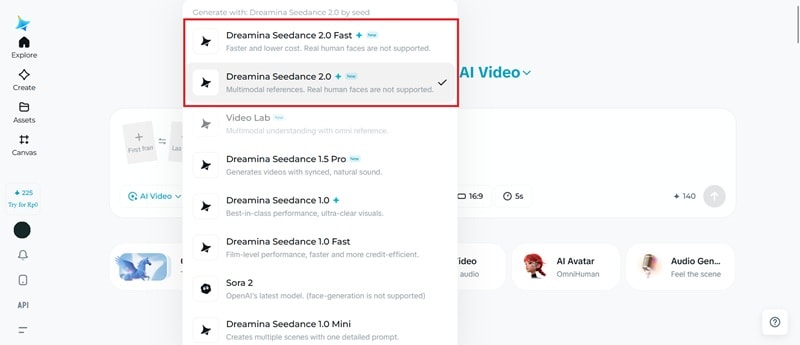

Quindi, scegli tra due livelli di modello:

- Dreamina Seedance 2.0 Fast:

- .

| 2,465 | 6,080 | 12,870 |

ToMoviee AISeedance 2.0

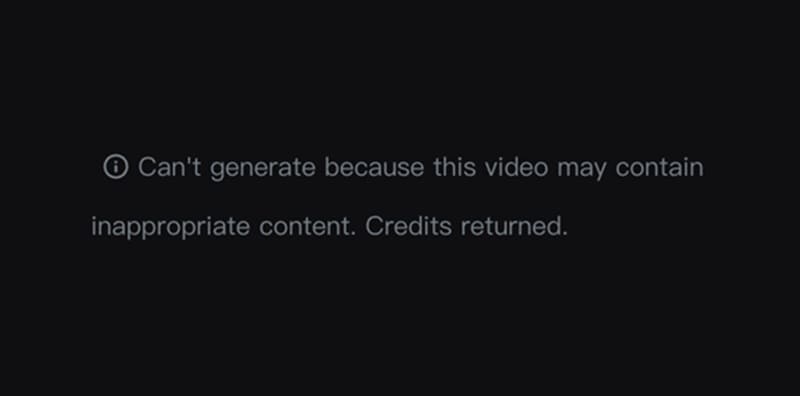

In risposta a questa pressione legale, ByteDance ha anche implementato nuove rigide "Linee Rosse" all'interno dello strumento, tra cui:

- Blocchi IP: Il sistema ora utilizza uno scanner in tempo reale per bloccare la generazione di franchise protetti come Marvel, Star WarsDC.

- Nessun riferimento a volti reali: Non è più possibile caricare foto di persone reali come riferimenti.

Sono stati implementati anche altri filtri per garantire un ambiente sicuro, tra cui violenza esplicita, nudità, e scenari politici ad alto rischio.

Parte 4. Punti di forza e limitazioni di Seedance AI a colpo d'occhio

In base a quanto abbiamo trattato finora, le prestazioni complessive di Seedance AI, in particolare l'ultimo Seedance 2.0, possono essere riassunte come segue.

- Controllo incredibile. Il sistema "Omni Reference" ti consente di bloccare personaggi, movimento e stile utilizzando i tuoi file. Non più "supposizioni" su ciò che l'IA costruirà.

- Sincronizzazione perfetta. Poiché audio e video vengono generati insieme, il sincronismo labiale e gli effetti sonori sono perfetti fotogramma per fotogramma fin dall'inizio.

- Migliore stabilità. È leader nel mantenere coerenti personaggi e costumi. Non vedrai la maglietta di un personaggio cambiare colore a metà della clip.

- Nessun riferimento al volto e rigorosa moderazione dei contenuti. Non puoi utilizzare volti reali riconoscibili come input di riferimento. La moderazione dei contenuti è anche piuttosto sensibile e bloccherà prompt che toccano argomenti anche remotamente controversi.

- Sei ancora limitato a brevi sequenze. Se vuoi una scena completa, preparati a fare un lavoro pesante nel tuo software di editing e unire più clip manualmente.

- Consumo elevato di crediti per generazioni complesse. L'aggiunta di più file di riferimento o l'aumento della durata della clip costerà significativamente più crediti per generazione.

Parte 5. Come Seedance AI si confronta con altri modelli AI

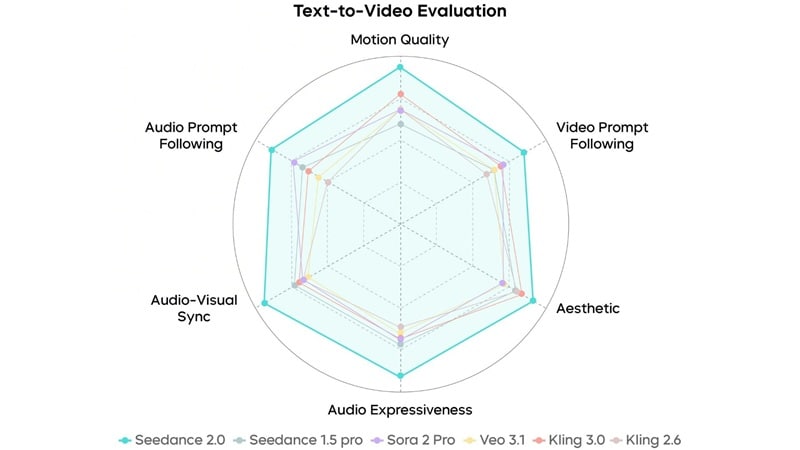

Oltre al generatore video Seedance AI, molti concorrenti come Kling, Sora e Veo 3.1 hanno anche lasciato il loro segno nel settore. Quindi, come si comporta effettivamente Seedance rispetto a loro?

| Seedance 2.0 | Kling 3.0 | Veo 3.1 | Sora 2 | |

| Punto di forza principale | Regia multimodale | Fisica e realismo | Qualità cinematografica | Ragionamento narrativo |

| Risoluzione max. | 1080p | 4K nativo (Pro) | 1080p | 1080p |

| Durata max. | 15 secondi | 15 secondi | 8 secondi | 25 secondi (per pro) |

| File di input | Fino a 12 file | Fino a 7 file | Fino a 3 file | 1-2 file |

| Controllo telecamera | Tramite video di riferimento e @menzioni | Pennello movimento e direzioni | Tramite API e prompt | Principalmente basato su testo |

| Input multimodali | Quad-modale (testo, immagine, video, audio) | Tri-modale (testo, immagine, video) | Tri-modale (testo, immagine, video) | Bi-modale (testo, immagine) |

Nel flusso di lavoro text-to-video, Seedance 2.0 è particolarmente dominante nella sua nativa integrazione audio-visiva, grazie all'uso di trasformatori di diffusione a doppio ramo. Sebbene abbia ancora margini di crescita, questo ha già stabilito un nuovo standard per l'industria.

Renderizzando audio ad alta fedeltà, come effetti sonori ambientali e sincronizzazione labiale, esattamente nello stesso momento dei fotogrammi video, agisce essenzialmente come un "regista multimodale" capace di mantenere una rigorosa coerenza narrativa e dei personaggi attraverso scene complesse e sequenze multi-ripresa.

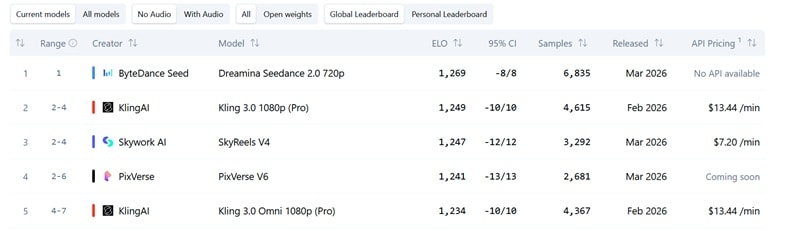

Nei più recenti test ciechi indipendenti di Artificial Analysis, Seedance 2.0 ha anche conquistato il primo posto nella categoria Text-to-Video con un punteggio Elo di 1.269 (senza audio) e 1.213 (con audio), e si posiziona tra i migliori in Image-to-Video.

La società di consulenza svizzera CTOL ha anche definito Seedance 2.0 il "modello di generazione video AI più avanzato disponibile," superando persino Sora 2 e Veo 3.1 nei test pratici. Il vero elemento distintivo è la sua capacità di funzionare sia come regista che come editor.

Parte 6. Migliora e perfeziona i tuoi risultati Seedance AI

Poiché Seedance 2.0 funziona all'interno di Filmora, puoi generare una ripresa e passare direttamente alla rifinitura: tagliare, correggere il colore e mixare nello stesso progetto. Anche se hai prodotto clip prima in Dreamina o CapCut, Filmora è costruito per unire quei pezzi AI in una storia finita con strumenti di editing professionali. Per archi più lunghi in stile episodio, i modelli di cortometraggi AI di Filmora sono un modo utile per pianificare battute e struttura delle scene quando ogni clip Seedance è ancora breve di per sé.

Ecco cosa rende Filmora una solida corrispondenza per l'output di Seedance:

- Editor video basato su timeline multipista: Vai oltre la generazione di singole clip. Sovrapponi il tuo filmato Seedance con testo, overlay e B-roll secondari per costruire una narrazione multidimensionale.

- AI Video Extend: Se la tua clip Seedance termina un momento troppo presto, usa AI Extend di Filmora per generare intelligentemente alcuni fotogrammi extra per uniformare i tempi e correggere tagli goffi.

- Correzione colore avanzata e supporto LUT: Le clip AI possono talvolta variare nel tono tra i prompt. Usa LUT professionali in Filmora per unificare la correzione del colore tra scene diverse.

- Editing audio e riduzione del rumore: Mentre Seedance 2.0 genera un suono impressionante, Filmora ti consente di masterizzarlo. Usa il denoise alimentato da AI per pulire gli artefatti o AI Audio Stretch per adattare perfettamente la musica di sottofondo alla durata della tua scena.

- Libreria integrata di effetti e transizioni: Aggiungi quel "brillantezza" professionale finale con migliaia di elementi di movimento e transizioni che aiutano a mascherare eventuali incoerenze generate dall'AI.

Insieme, Seedance 2.0 e Filmora coprono l'arco dalla prima generazione al montaggio finale, specialmente quando generi e modifichi in un unico posto.

Conclusione

Se ti occupi di creazione video o storytelling digitale, Seedance 2.0 è lo strumento che devi provare quest'anno. L'aggiornamento che ByteDance porta stabilisce un nuovo benchmark di settore per il controllo multimodale, spostando finalmente il video AI in una direzione più precisa.

Inoltre, puoi unire le clip iper-realistiche di Seedance con gli strumenti di editing di Filmora—generazione Seedance 2.0 integrata nell'app, ToMoviee AI (modelli basati su Seedance 2.0) e controllo completo della timeline—per costruire storie che prima richiedevano un'intera casa di post-produzione.

FAQ

-

1. Perché non riesco a vedere Seedance 2.0 su Dreamina?

Seedance 2.0 è ancora in fase di implementazione graduale per regione. Se non lo vedi ancora, la tua regione potrebbe non avere ancora accesso. Controlla regolarmente o prova ad accedervi tramite una regione supportata. -

2. Quanto tempo ci vuole per generare video con Seedance AI?

Il tempo di generazione varia a seconda del modello e della complessità del tuo prompt. Seedance 2.0 Fast di solito produce risultati in meno di un minuto, mentre il modello completo Seedance 2.0 può richiedere da uno a diversi minuti a causa dell'output di qualità superiore. L'aggiunta di più file di riferimento, l'aumento della durata della clip o la richiesta di risoluzione più alta aggiungeranno anche tempo di elaborazione. -

3. Posso usare Seedance 2.0 al di fuori di Dreamina o CapCut?

Sì. Piattaforme di terze parti come Topview AI hanno integrato Seedance 2.0. In Wondershare Filmora, Seedance 2.0 è integrato per la generazione della timeline, e l'hub dei ToMoviee AI template si concentra su flussi di lavoro basati su storyboard in stile Seedance 2.0—così puoi generare, partire da un modello e modificare in un unico ecosistema. -

4. Posso usare Seedance 2.0 gratuitamente?

Sebbene tu riceva crediti gratuiti per generare video, l'accesso a Seedance 2.0 AI su CapCut o Dreamina richiede comunque un abbonamento a pagamento.